Україна

Дослідник OpenAI закликає до незалежного аудиту ШІ-моделей

Дослідник OpenAI Бенджамін Арнав пропонує запровадити незалежний аудит ШІ-моделей і стандартизовані оцінки для підвищення прозорості та безпеки.

Дослідник OpenAI Бенджамін Арнав закликає спільноту штучного інтелекту переглянути методи оцінки моделей через їхню відсутність прозорості. Згідно з його заявами, нинішня система тестів є ненадійною, оскільки показники прогресу часто створюються за різними умовами і вводять у оману розробників та користувачів. Непослідовні методології ускладнюють порівняння рішень між різними компаніями, що впливає на безпеку та розгортання технологій.

Арнав наводить приклад бенчмарку SWE-bench Verified, де різні версії моделей тестувалися з різною кількістю завдань та інструментів. Компанії, такі як Anthropic та OpenAI, змінювали параметри випробувань майже з кожним релізом, що робить результати несумісними. Наприклад, Google спочатку обмежував інформацію про Gemini 2.5, тоді як інші гравці не завжди розкривали деталі оцінювання.

Вчений порівнює ситуацію з іншими галузями, де функцію вимірювання передали незалежним аудиторам. Він пропонує запровадити аналогічну практику для ШІ, коли компанії надавали б свої системи для стандартизованого тестування стороннім організаціям. Це дозволить публікувати результати одночасно з релізами та підвищити довіру до технологій.

Як альтернативу повній незалежності Арнав розглядає узгодження спільних стандартів для відкритих бенчмарків. Це дозволить хоча б частково зменшити розрив між заявленими результатами різних моделей. Дослідник підкреслює, що без стандартизованих оцінок неможливо забезпечити належний рівень безпеки та обґрунтованих рішень щодо впровадження ШІ в суспільство.

Читайте також

- Українець створив безкоштовний сервіс для відстеження російських атак в реальному часі

- Суд OpenAI проти Маска: бізнесмен вимагав контролю над компанією та $80 млрд на Марс

- ChatGPT оновлено: нова модель пам'ятатиме більше, а помилятиметься менше

- Білий дім розглядає нові обмеження для ШІ: чи це змінить правила гри?

- OpenAI готує власний смартфон ChatGPT: вихід на ринок очікується у 2027 році

Новини цього розділу

ЦПД попередив про шахрайську схему у месенджері Signal

ЦПД попередив про шахрайську схему у месенджері Signal

Apple виплатить до 95 доларів власникам iPhone за «неіснуючий» ШІ

Apple виплатить до 95 доларів власникам iPhone за «неіснуючий» ШІ

Casio G-Shock Electro Green: неонові годинники з сонячною зарядкою вже в Україні

Casio G-Shock Electro Green: неонові годинники з сонячною зарядкою вже в Україні

Зарплати розробників в Україні: шоковий спад у 2026 році

Зарплати розробників в Україні: шоковий спад у 2026 році

«Дія» не самоокупна: доходи покривають лише 10% витрат через рішення АМКУ

«Дія» не самоокупна: доходи покривають лише 10% витрат через рішення АМКУ

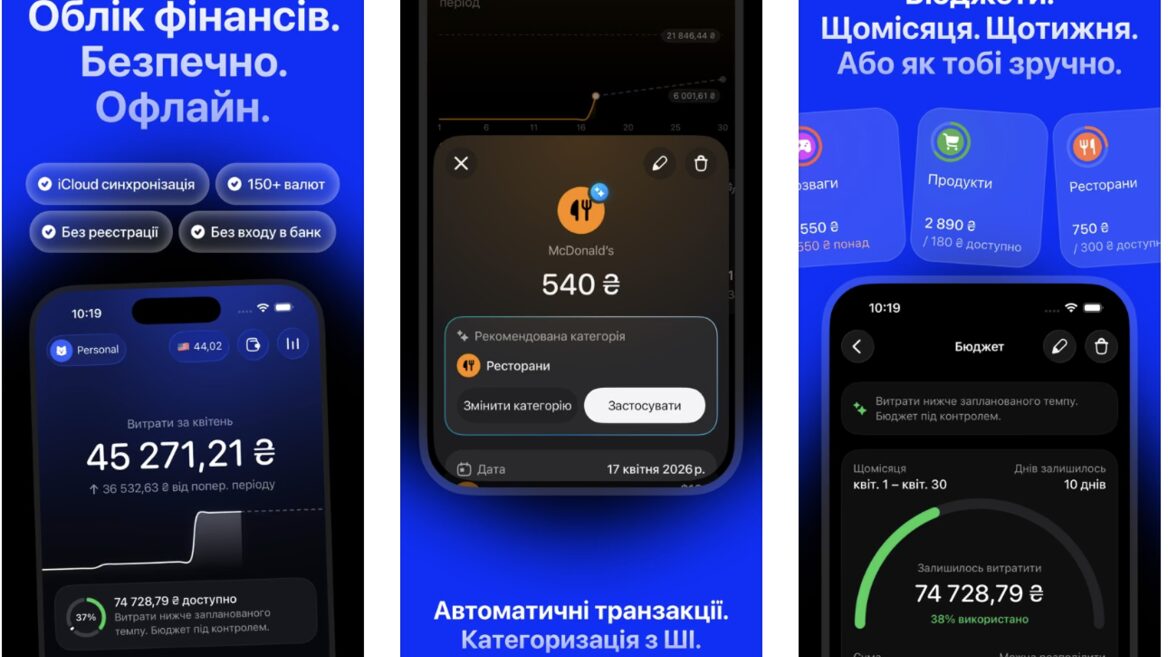

Українець розробив iOS-додаток Expensa для розумного обліку фінансів із ШІ

Українець розробив iOS-додаток Expensa для розумного обліку фінансів із ШІ

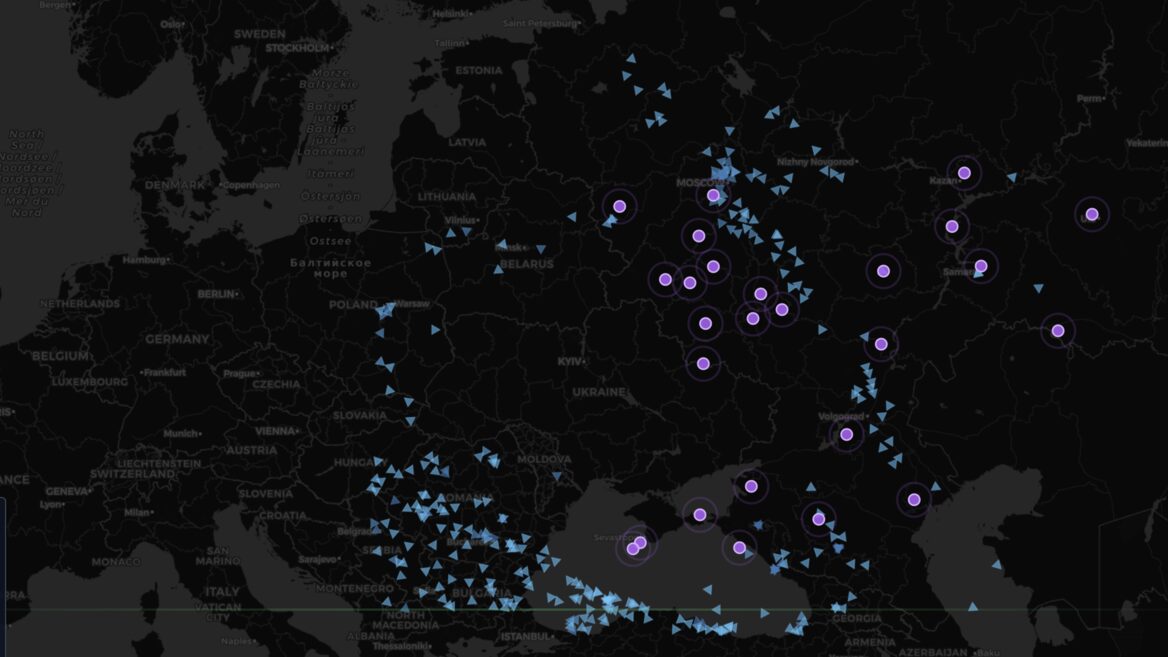

Українець створив безкоштовний сервіс для відстеження російських атак в реальному часі

Українець створив безкоштовний сервіс для відстеження російських атак в реальному часі

Українська Farsight Vision навчила нейромережу розпізнавати антени РЕБ та сліди коліс на знімках

Українська Farsight Vision навчила нейромережу розпізнавати антени РЕБ та сліди коліс на знімках

Meta запускає власного ШІ-агента Hatch та інтегрує покупки в Instagram

Meta запускає власного ШІ-агента Hatch та інтегрує покупки в Instagram

SpaceX планує будівництво заводу чипів Terafab у Техасі з інвестиціями у 55 млрд доларів

SpaceX планує будівництво заводу чипів Terafab у Техасі з інвестиціями у 55 млрд доларів

Коментарі

Коментарів ще немає. Будьте першим у цій дискусії.