Україна

Штучний інтелект у медицині: нейромережа перевершила лікарів у складній діагностиці

Новий експеримент з використанням моделі o1-preview від OpenAI показав, що штучний інтелект може ставити діагнози точніше за людей, особливо у складних випадках, та пояснювати свої висновки.

У приймальних відділеннях лікарі часто працюють у режимі екстреного реагування, маючи лише кілька хвилин для прийняття рішень, що можуть врятувати життя. Новий експеримент демонструє, що частину цієї критичної роботи вже здатна виконувати нейромережа, і подекуди вона робить це не гірше, а іноді й краще за досвідчених фахівців.

Дослідники перевірили модель o1-preview від OpenAI, яка здатна до так званого «міркування», на складних клінічних завданнях. Перед тим як дати відповідь, система перебирає кілька варіантів, перевіряє висновки й уточнює рішення, імітуючи процес аналізу симптомів людським мозком. На основі верифікованих клінічних випадків модель поставила правильний діагноз у 89% ситуацій, тоді як попередня версія GPT‑4 показала лише 73% точності.

Найбільша перевага штучного інтелекту виявилася у рідкісних та складних випадках, таких як незвичні інфекції, ушкодження серця, аутоімунні захворювання легень або ураження печінки. У окремих завданнях нейромережа обігнала не лише інші алгоритми, а й групу з сотень лікарів, краще визначаючи необхідні аналізи та стратегію лікування.

Окремий етап тестування пройшов на реальних даних із приймального відділення лікарні в Бостоні, де взяли участь 70 пацієнтських випадків. Модель перевершила двох досвідчених лікарів на етапах сортування за терміновістю, аналізу симптомів та прийняття рішень про госпіталізацію. При «сліпій» оцінці незалежні експерти не змогли стабільно відрізнити висновки нейромережі від професійних діагнозів.

Важливою особливістю роботи системи є те, що вона не просто видає відповідь, а пояснює свої висновки, показуючи, які ознаки підтверджують діагноз, а які йому суперечать. Такий підхід робить роботу ШІ прозорішою та потенційно кориснішою для лікаря, який приймає фінальне рішення, особливо коли інформації ще мало, а діяти потрібно негайно.

Попри успішні результати, дослідники наголошують, що це не означає готовність штучного інтелекту замінити лікаря. Діагностика — лише частина медичної практики, де важливі зовнішній вигляд, дихання та реакція пацієнта, що модель не може оцінити, працюючи лише з текстовими даними. Розробники вважають, що подібні системи слід розглядати як помічників, а не заміну фахівців, а подальші випробування мають проходити під суворим наглядом у реальних умовах.

Читайте також

- Штат Пенсільванія попросив суд захистити пацієнтів від чат-ботів, які видають себе за лікаря

- Цукерберг інвестує пів мільярда доларів у штучний інтелект для боротьби з хворобами

- Медичний одяг: чому вибір уніформи впливає на здоров'я пацієнтів та комфорт лікарів

- Прорив у медицині: ШІ виявляє рак підшлункової залози за 16 місяців до діагнозу

- Штучний інтелект знайшов приховані сперматозоїди: нова надія для українських сімей із діагнозом азооспермія

Новини цього розділу

ЦПД попередив про шахрайську схему у месенджері Signal

ЦПД попередив про шахрайську схему у месенджері Signal

Apple виплатить до 95 доларів власникам iPhone за «неіснуючий» ШІ

Apple виплатить до 95 доларів власникам iPhone за «неіснуючий» ШІ

Casio G-Shock Electro Green: неонові годинники з сонячною зарядкою вже в Україні

Casio G-Shock Electro Green: неонові годинники з сонячною зарядкою вже в Україні

Зарплати розробників в Україні: шоковий спад у 2026 році

Зарплати розробників в Україні: шоковий спад у 2026 році

«Дія» не самоокупна: доходи покривають лише 10% витрат через рішення АМКУ

«Дія» не самоокупна: доходи покривають лише 10% витрат через рішення АМКУ

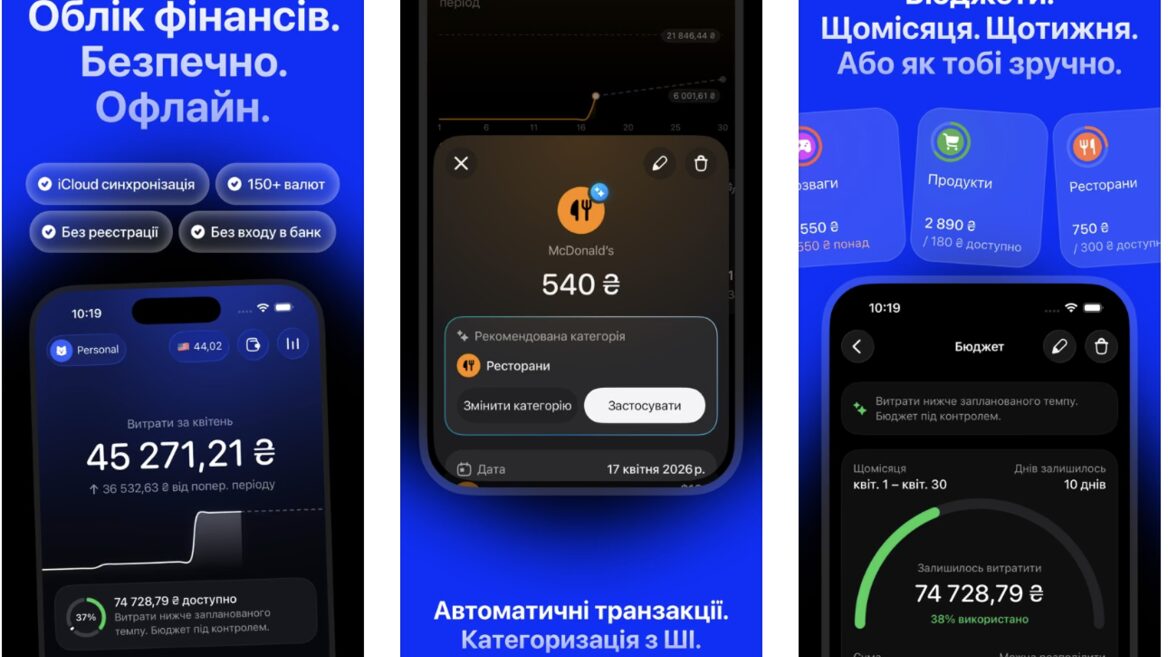

Українець розробив iOS-додаток Expensa для розумного обліку фінансів із ШІ

Українець розробив iOS-додаток Expensa для розумного обліку фінансів із ШІ

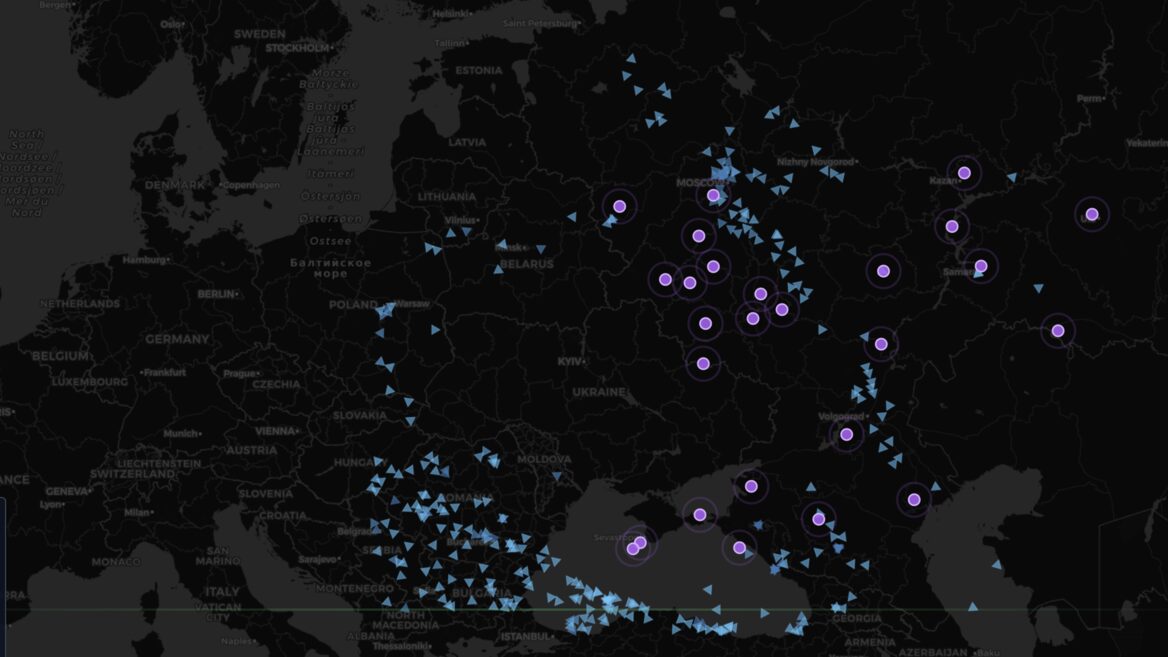

Українець створив безкоштовний сервіс для відстеження російських атак в реальному часі

Українець створив безкоштовний сервіс для відстеження російських атак в реальному часі

Українська Farsight Vision навчила нейромережу розпізнавати антени РЕБ та сліди коліс на знімках

Українська Farsight Vision навчила нейромережу розпізнавати антени РЕБ та сліди коліс на знімках

Meta запускає власного ШІ-агента Hatch та інтегрує покупки в Instagram

Meta запускає власного ШІ-агента Hatch та інтегрує покупки в Instagram

SpaceX планує будівництво заводу чипів Terafab у Техасі з інвестиціями у 55 млрд доларів

SpaceX планує будівництво заводу чипів Terafab у Техасі з інвестиціями у 55 млрд доларів

Коментарі

Коментарів ще немає. Будьте першим у цій дискусії.