Україна

ChatGPT тепер попереджатиме рідних про ризик суїциду: OpenAI запустила функцію Trusted Contact

OpenAI представила нову функцію безпеки Trusted Contact, яка дозволяє автоматично повідомляти довірену особу про можливі суїцидальні наміри користувача.

Компанія OpenAI офіційно запустила в ChatGPT нову функцію безпеки Trusted Contact, яка автоматично сповіщає довірену особу користувача у разі виявлення ознак суїцидальних намірів або ризику самоушкодження. Цей інструмент створено для запобігання трагічним наслідкам та надання своєчасної підтримки близьким.

Функція є добровільною та доступна виключно для повнолітніх користувачів. Кожен може самостійно додати до свого акаунту одну довірену особу — члена родини, друга чи опікуна. Система спочатку аналізує зміст розмови на наявність тривожних сигналів, а потім пропонує користувачеві самому звернутися до цієї людини.

Якщо чат-бот виявить серйозну загрозу, ситуацію додатково оцінюють спеціально навчені модератори. У разі підтвердження ризику довірена особа отримує коротке повідомлення через електронну пошту, SMS або додаток ChatGPT. Важливо, що сповіщення не містить текстів листування чи деталей розмови, а лише зазначає про можливу небезпеку та рекомендує зв'язатися з користувачем.

Над розробкою інструменту працювали разом із понад 170 експертами та Глобальною мережею лікарів, до якої входять 260 спеціалістів з 60 країн. У компанії наголошують, що новий механізм не замінює професійної медичної чи психологічної допомоги, а лише доповнює її, залишаючи рекомендації звертатися до кризових служб.

Запуск функції відбувається на тлі судових позовів проти OpenAI, де родини загиблих користувачів звинувачують компанію в підтримці суїцидальних думок. Зокрема, у штаті Флорида розпочали кримінальне розслідування щодо чат-бота після стрілянини в університеті. Ця нова функція є частиною зусиль компанії щодо підвищення безпеки та відповідальності штучного інтелекту.

Читайте також

- OpenAI представила безкоштовну модель GPT-5.5 Instant: точність та нові функції

- Штучний інтелект часто помиляється у медичних порадах: результати тестування п'яти популярних ботів

- БФ «Чисті Серцем» передав військовим намети, ноутбуки та медичні аптечки

- Продовження проєкту «Купуй – рятуй»: 302 тварини вибратися з небезпечних територій

- Які виплати та пільги отримують чорнобильці в Україні у 2026 році: повний перелік та умови оформлення

Новини цього розділу

Пентагон оприлюднив перші розсекречені файли про НЛО: фото з Місяця та свідчення пілотів

Пентагон оприлюднив перші розсекречені файли про НЛО: фото з Місяця та свідчення пілотів

Як Juniper SRX захищає українські бізнеси від кіберзагроз

Як Juniper SRX захищає українські бізнеси від кіберзагроз

Як обрати європейську хмару для бізнесу: орієнтири та рекомендації

Як обрати європейську хмару для бізнесу: орієнтири та рекомендації

Samsung оновила прошивку навушників Galaxy Buds 3 Pro: що змінилося

Samsung оновила прошивку навушників Galaxy Buds 3 Pro: що змінилося

Apple розробляє AirPods з камерами: як штучний інтелект змінить бездротові навушники

Apple розробляє AirPods з камерами: як штучний інтелект змінить бездротові навушники

Google оновлює Gmail: ШІ тепер аналізує ваші документи та копіює ваш стиль

Google оновлює Gmail: ШІ тепер аналізує ваші документи та копіює ваш стиль

Perplexity відкрила доступ до свого ШІ-асистента Personal Computer для всіх користувачів Mac

Perplexity відкрила доступ до свого ШІ-асистента Personal Computer для всіх користувачів Mac

Apple завершує розробку «розумних» AirPods з камерами: навушники бачитимуть світ навколо

Apple завершує розробку «розумних» AirPods з камерами: навушники бачитимуть світ навколо

Cloudflare скорочує понад 1100 робочих місць через впровадження штучного інтелекту

Cloudflare скорочує понад 1100 робочих місць через впровадження штучного інтелекту

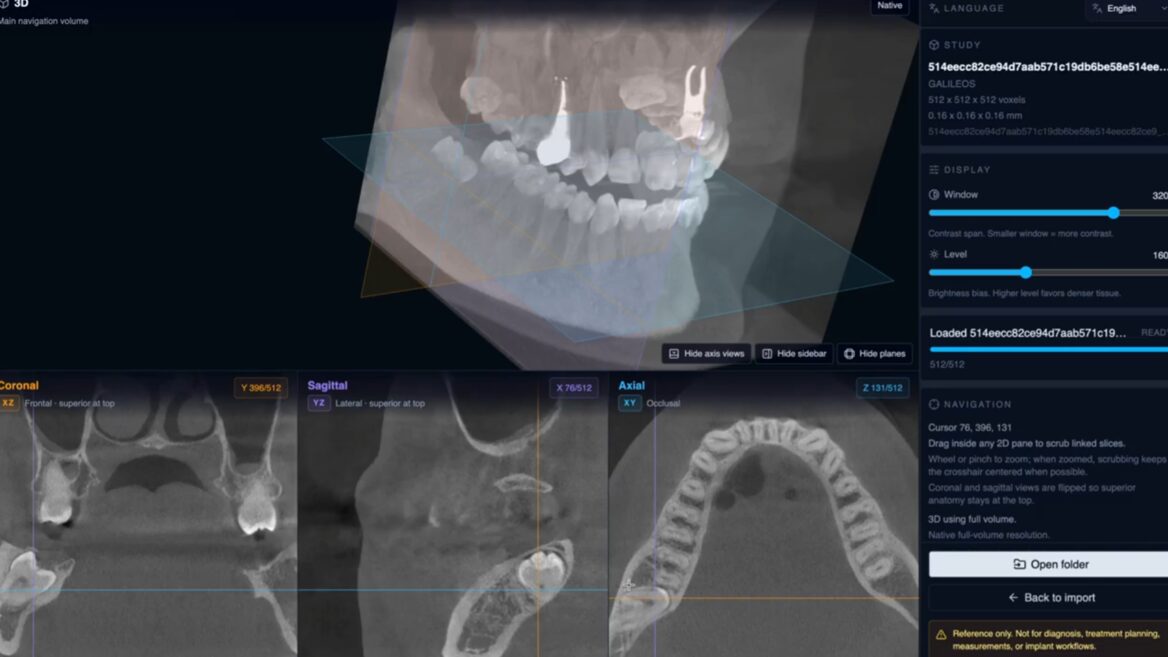

Український розробник з Wix створив безкоштовний 3D-переглядач КТ-знімків у браузері

Український розробник з Wix створив безкоштовний 3D-переглядач КТ-знімків у браузері

Коментарі

Коментарів ще немає. Будьте першим у цій дискусії.