Україна

Епоха трансформерів добігає кінця: чому ШІ-моделі вийшли на технологічне плато

Директор департаменту штучного інтелекту компанії Sponge Анар Лавренов стверджує, що архітектура трансформерів застаріла, що призвело до стагнації розвитку великих мовних моделей.

Великі мовні моделі (LLM), що стали основою сучасного штучного інтелекту, досягли свого технологічного плато. Директор департаменту штучного інтелекту компанії Sponge Анар Лавренов заявив, що архітектура трансформерів, якій незабаром виповниться 10 років, вичерпала свій потенціал і потребує радикальної заміни для подальшого прориву.

Лавренов підкреслив, що бенчмарки нових моделей майже не змінюються, а істотних покращень у їхній роботі не спостерігається. Приклади таких систем, як Claude Opus 4.7, 4.6 та Gemini 3.1, демонструють однакові результати, що свідчить про вичерпання можливостей існуючого коду та архітектурних рішень.

Експерт порівняв ситуацію з неможливістю створити супервелосипед, якщо конструкція залишається незмінною з двома колесами та трубами. Він зазначив, що всі провідні компанії, зокрема Microsoft, Spotify та OpenAI, усвідомлюють цю проблему, оскільки всі вони використовують одну й ту саму застарілу архітектуру.

Водночас Лавренов закликає не панікувати щодо майбутнього галузі. Він категорично заперечує тезу про те, що штучний інтелект є «бульбашкою», називаючи його важливим напрямком розвитку. На його думку, світ чекає на появу нової архітектури, яка стане таким же стрибком, як перехід від рекурентних моделей до трансформерів з виходом GPT 3.5.

У найближчому майбутньому ринок технологій може зазнати змін, оскільки компанії будуть змушені шукати нові підходи до розробки, щоб не відстати від інновацій. Впровадження нових протоколів та архітектурних рішень здатне змінити правила гри в сфері штучного інтелекту та забезпечити новий етап його еволюції.

Читайте також

- Meta купує стартап для розробки штучного інтелекту гуманоїдних роботів

- ШІ навчив робопеса балансувати на кулі краще за людей

- Вартість Apple перевершує суму трьох конкурентів: ключові факти про технологічний лідера

- Preply вперше викупила акції у співробітників: українська команда отримала прибуток до IPO

- Vodafone викупить частку у британському операторі за £4,3 млрд

Новини цього розділу

Лідери цифровізації України визначили пріоритети на 2026 рік

Лідери цифровізації України визначили пріоритети на 2026 рік

Штучний інтелект вперся у стелю: експерт розкрив новий вектор розвитку технологій

Штучний інтелект вперся у стелю: експерт розкрив новий вектор розвитку технологій

SpaceX вивела на орбіту корейський супутник, запуск якого затримала війна в Україні

SpaceX вивела на орбіту корейський супутник, запуск якого затримала війна в Україні

Наземні роботи повернулися на фронт: як НРК стали незамінними в логістиці

Наземні роботи повернулися на фронт: як НРК стали незамінними в логістиці

Wix розширює команду в Україні та інвестує в безкодові застосунки

Wix розширює команду в Україні та інвестує в безкодові застосунки

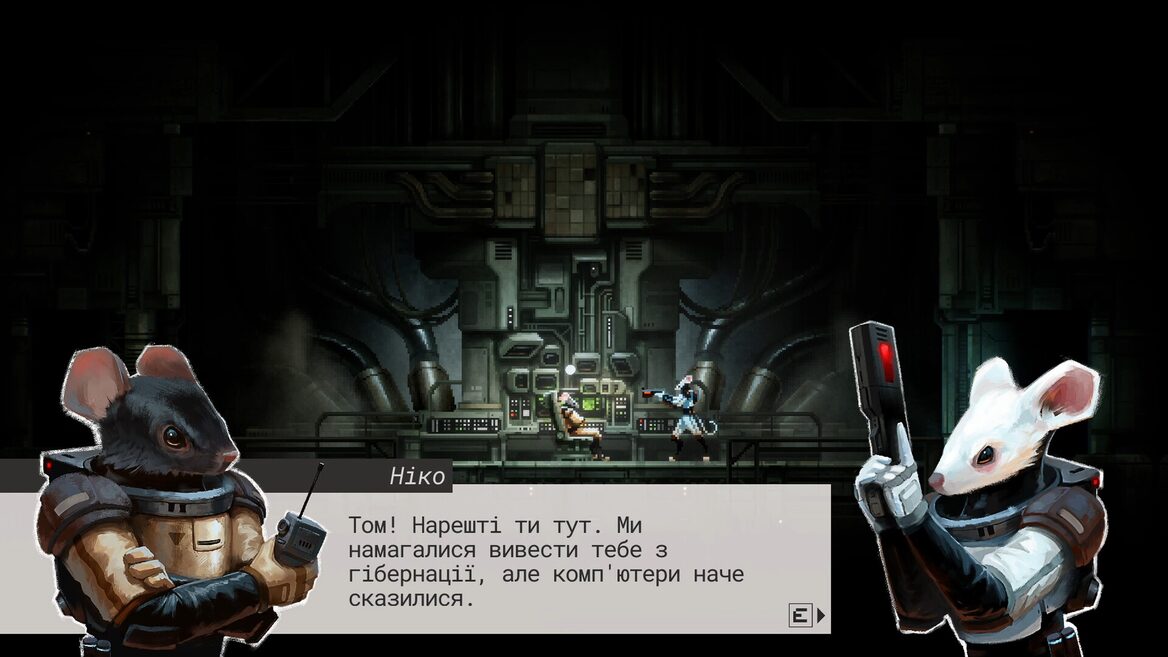

Український розробник презентував атмосферний екшен-платформер Distantia про гризунів на космічній станції

Український розробник презентував атмосферний екшен-платформер Distantia про гризунів на космічній станції

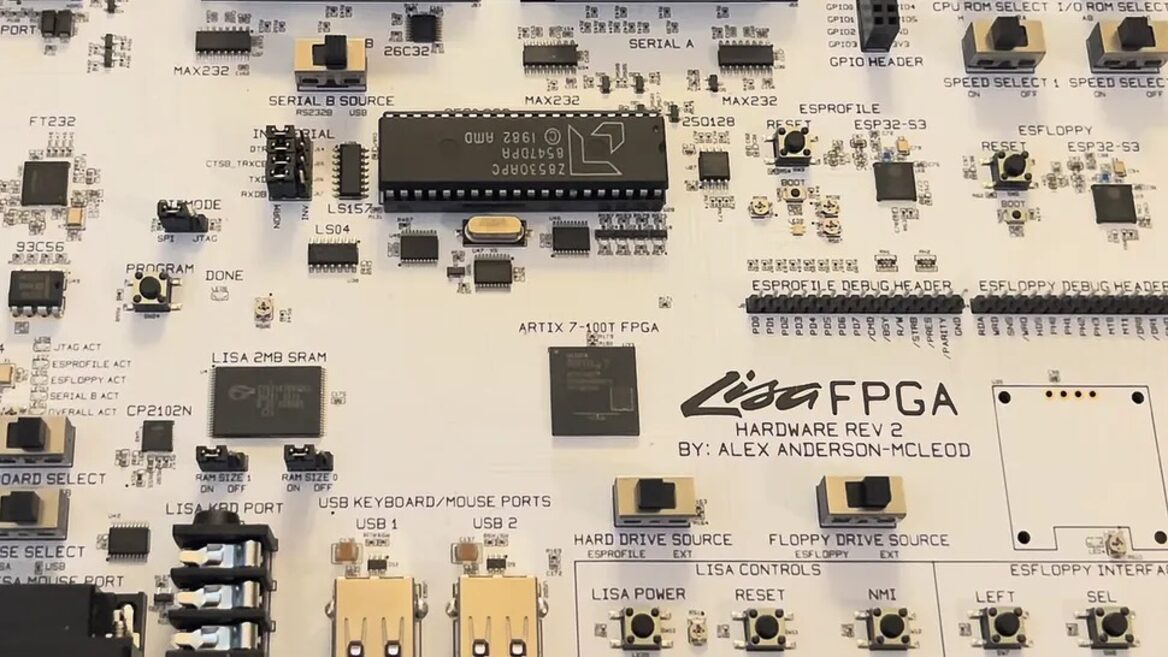

Український читач дізнався: як ютубер воскресив Apple Lisa замість $10 000

Український читач дізнався: як ютубер воскресив Apple Lisa замість $10 000

McLaren представила два гіперкари MCL-HY: один для Ле-Мана, інший — для приватних колекціонерів

McLaren представила два гіперкари MCL-HY: один для Ле-Мана, інший — для приватних колекціонерів

Робот-екскурсовод R1 представлено в історичному палаці Турину

Робот-екскурсовод R1 представлено в історичному палаці Турину

Діти обходять вікові обмеження онлайн: дослідження показало, що навіть намальовані вуси допомагають

Діти обходять вікові обмеження онлайн: дослідження показало, що навіть намальовані вуси допомагають

Коментарі

Коментарів ще немає. Будьте першим у цій дискусії.