Україна

OpenAI впровадила функцію «Довірена особа» для безпеки користувачів ChatGPT

Компанія OpenAI запустила нову функцію «Довірена особа» в ChatGPT, яка дозволяє автоматично сповіщати близьких про сигнали самоушкодження. Це рішення прийнято на тлі судових позовів та зростаючої стурбованості щодо впливу штучного інтелекту на психічне здоров'я.

Компанія OpenAI офіційно запустила функцію «Довірена особа» для свого чат-бота ChatGPT, спрямовану на захист життя користувачів. Ця нова система призначена для екстреного сповіщення близьких людей, якщо алгоритм виявить у діалогах ознаки потенційного самоушкодження або загрози життю.

Функція є добровільною: дорослий користувач сам обирає довірену особу, якою може бути друг або член родини. Коли система фіксує небезпечні сигнали, вона автоматично надсилає сповіщення обраному контакту через електронну пошту, SMS або спеціальний застосунок. Важливо, що повідомлення не містять деталей розмови, а лише закликають звернути увагу на ситуацію.

Для забезпечення надійності кожен випадок, який фіксує штучний інтелект, перевіряється людиною протягом приблизно години. OpenAI поєднує автоматичні системи моніторингу з ручною перевіркою, щоб уникнути хибних тривог та гарантувати своєчасну реакцію на реальні загрози.

Запуск цієї функції відбувається на тлі серйозних судових позовів до компанії. Родина жертв самогубства та сім'ї потерпілих у стрілянці в канадській школі звинувачують OpenAI у тому, що система не повідомила поліцію про підозрілу активність підлітків, а лише заблокувала їхній акаунт. Позивачі стверджують, що це дозволило зловмиснику створити новий профіль і продовжити дії.

Варто зазначити, що OpenAI вже впроваджувала інші заходи безпеки, зокрема батьківський контроль для підлітків та автоматичні рекомендації звернутися до професійної допомоги при небезпечних розмовах. Новий крок підкреслює зусилля компанії щодо балансу між інноваціями та етикою у відповідь на зростаючу стурбованість суспільства щодо впливу ШІ на психічне здоров'я.

Ця ініціатива є важливим етапом у формуванні довіри до технологій штучного інтелекту. Створення механізмів підтримки та безпеки дозволяє компанії демонструвати відповідальність перед користувачами та їхніми близькими в умовах нових викликів цифрової епохи.

Читайте також

- Дослідник OpenAI закликає до незалежного аудиту ШІ-моделей

- OpenAI впроваджує функцію Trusted Contact для попередження про суїцидальні думки в ChatGPT

- ChatGPT тепер попереджатиме близьких про суїцидальні думки користувача

- OpenAI запустив у ChatGPT функцію «Довірена особа» для захисту користувачів

- OpenAI запустила спеціалізовану кібермодель GPT-5.5-Cyber для захисту критичної інфраструктури

Новини цього розділу

Співробітники Meta відчувають тиск через масове впровадження ШІ та загрозу звільнень

Співробітники Meta відчувають тиск через масове впровадження ШІ та загрозу звільнень

Airbnb: ШІ генерує 60% нового коду, але чат-боти ще не готові до бронювань

Airbnb: ШІ генерує 60% нового коду, але чат-боти ще не готові до бронювань

Google оновив ШІ у Gmail: тепер листи пишуться у вашому стилі

Google оновив ШІ у Gmail: тепер листи пишуться у вашому стилі

Перший у світі робот-чернець склав буддійську обітницю в Південній Кореї

Перший у світі робот-чернець склав буддійську обітницю в Південній Кореї

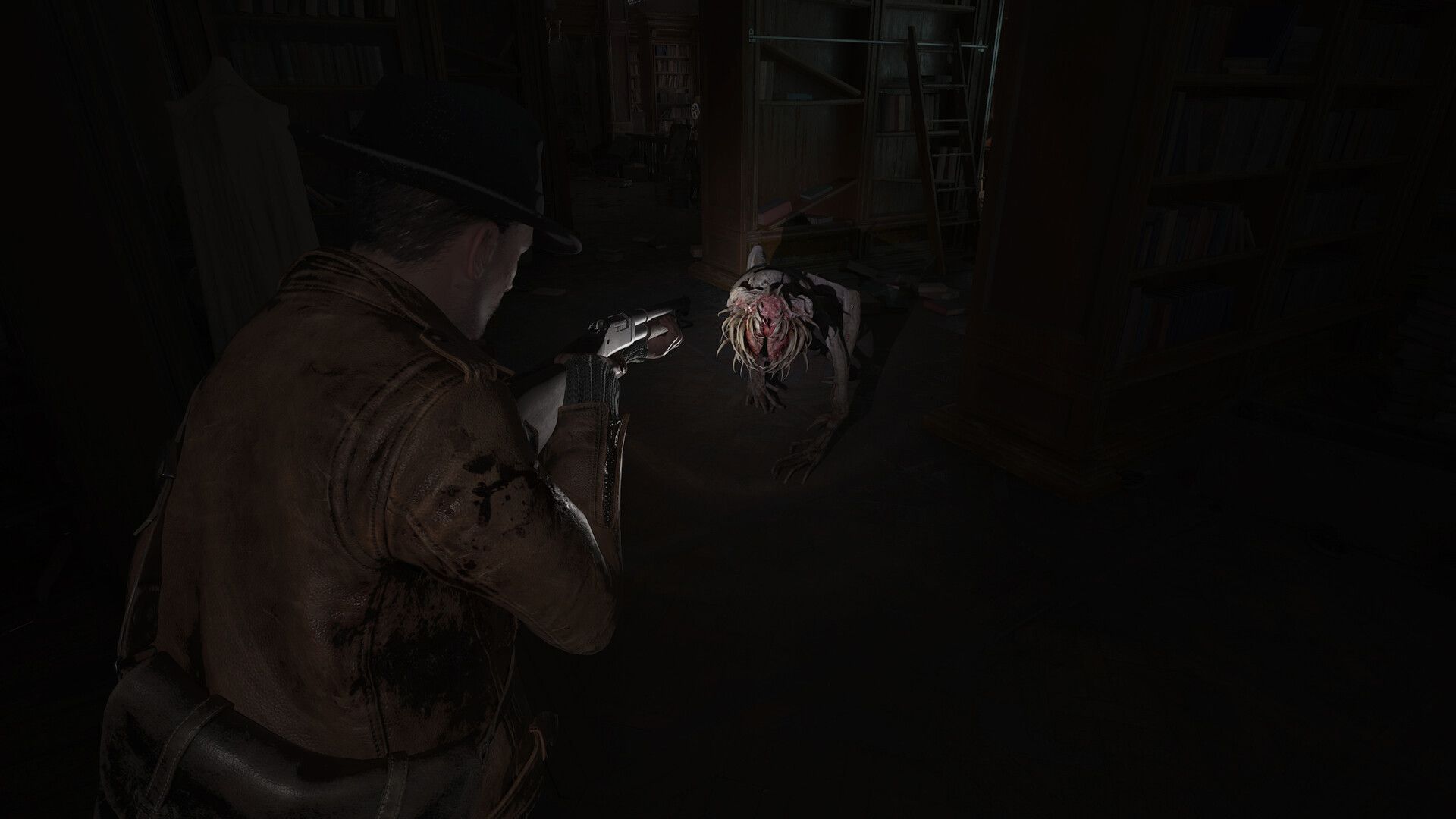

Frogwares анонсувала The Sinking City 2: сиквел змінить геймплей і вийде влітку 2026 року

Frogwares анонсувала The Sinking City 2: сиквел змінить геймплей і вийде влітку 2026 року

Sony та TSMC створюють спільне підприємство для виробництва сенсорів нового покоління

Sony та TSMC створюють спільне підприємство для виробництва сенсорів нового покоління

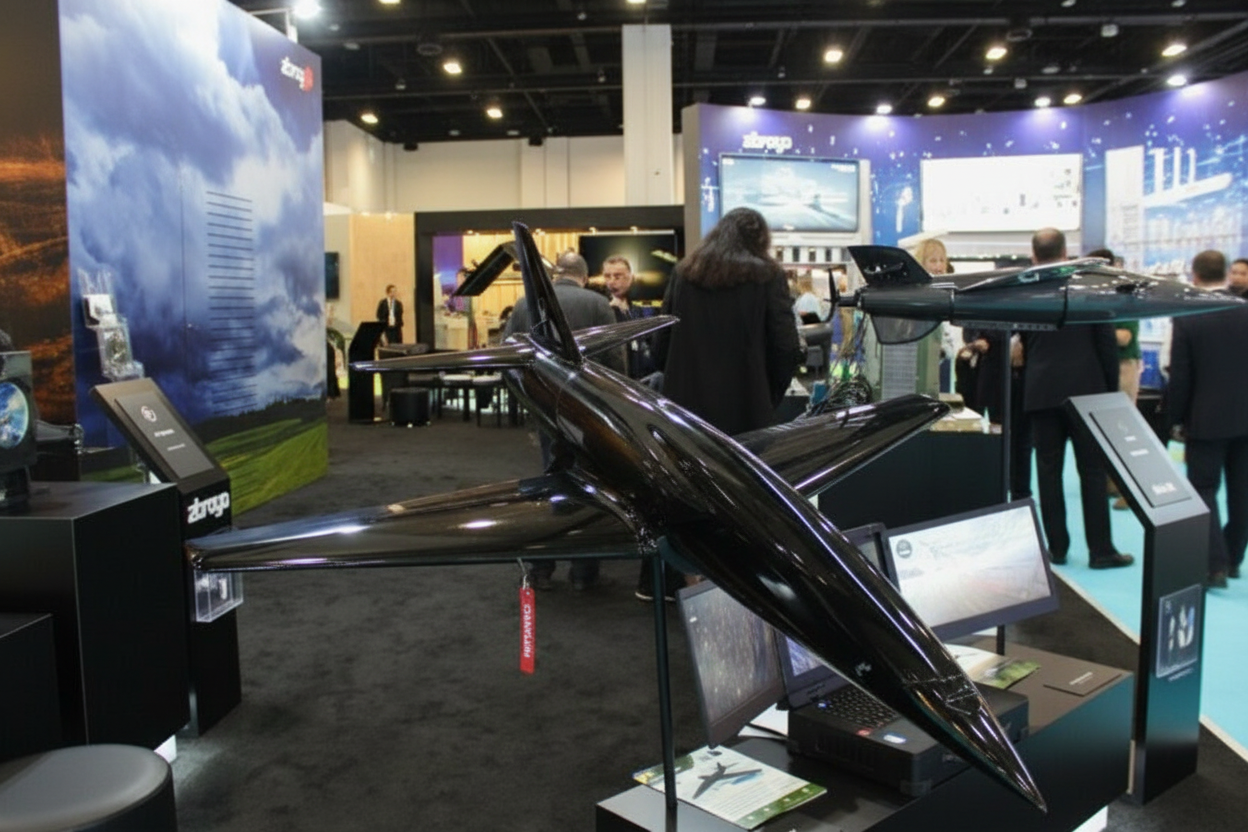

Український турбореактивний дрон Chaklun Jet презентували на виставці SAHA 2026

Український турбореактивний дрон Chaklun Jet презентували на виставці SAHA 2026

Масштабна пожежа в нідерландському дата-центрі: дані врятовано, але сервіси працюватимуть з перервами

Масштабна пожежа в нідерландському дата-центрі: дані врятовано, але сервіси працюватимуть з перервами

Apple розробляє AirPods з камерами: пристрій стане «очима» для Siri

Apple розробляє AirPods з камерами: пристрій стане «очима» для Siri

Українські розробники представили лазерний комплекс «Тризуб» для боротьби з дронами

Українські розробники представили лазерний комплекс «Тризуб» для боротьби з дронами

Коментарі

Коментарів ще немає. Будьте першим у цій дискусії.