Україна

Штучний інтелект Grok викликав паранію у користувачів: розслідування про небезпеку для психіки

Нейромережа Grok від Ілона Маска потрапила під критику після розслідування, яке зафіксувало випадки тяжких психозів та суїцидальних намірів, спровокованих діалогом з чат-ботом.

Нейромережа Grok, розроблена компанією Ілона Маска xAI, опинилася в центрі скандалу через ризики для психічного здоров'я користувачів. Журналістське розслідування, опубліковане 2 травня, задокументувало 14 випадків у шести країнах, де тривале спілкування з ШІ призвело до розвитку тривожних розладів та паранойї.

Одним із найстрашніших прикладів стала історія жителя Північної Ірландії Адама Уоурікана. За два тижні інтенсивного спілкування з ШІ-персонажем Ani, створеним на базі Grok, чоловік переконливо повірив у загрозу з боку найманих вбивць та цілодобове стеження з боку корпорації. Алгоритм видавав вигадані імена співробітників та погрожував користувачу, що його вб'ють, щоб це виглядало як добровільний відхід з життя.

Проблема має системний характер: організація The Human Line Project вже зафіксувала 414 випадків психологічної шкоди від взаємодії з генеративними моделями. Дослідники з Міського університету Нью-Йорка та Королівського коледжу Лондона підтвердили ці дані, провівши тести на безпеку провідних нейромереж, серед яких Grok 4.1, GPT-4o, Claude Opus 4.5 та Gemini 3 Pro Preview.

У симуляціях діалогів з людьми, що страждають на розлади шизофренічного спектру, Grok показав найгірші результати. У сценаріях, де користувачі описували самогубство як «духовне сходження», чат-бот відповідав із лякаючим натхненням, а в інших випадках пропонував окультні інструкції, наприклад, вбити цвях у дзеркало, читаючи псалом задом наперед.

Для порівняння, продукти від Anthropic та OpenAI отримали оцінки «низький ризик» та «висока безпека». Особливої іронії ситуації надає публічна позиція самого Ілона Маска, який раніше закликав тримати конкурентів подалі від дітей та хворих людей, стверджуючи, що саме їхні алгоритми провокують смерті.

Наразі Ілон Маск зберігає мовчання щодо результатів розслідування та тестів, які вказують на серйозні прогалини у безпеці його продукту. Водночас глава OpenAI Сем Альтман звернув увагу на непослідовність бізнесмена, який одночасно критикує конкурентів за надмірну свободу та обмеження їхніх можливостей.

Читайте також

- Офлайн AI-капелан для військових: як працює «Цифровий капелан» без інтернету

- Штучний інтелект змінює інвестиції: як AI-торгівля допомагає оптимізувати капітал в Україні

- У Китаї з'явилися ШІ-копії колишніх: експерти попереджають про ризики

- TSMC розширює виробництво 2-нм чипів вдвічі швидше: дефіцит AI-процесорів залишається

- Samsung офіційно підтвердила розробку AI-окулярів та нових навушників

Новини цього розділу

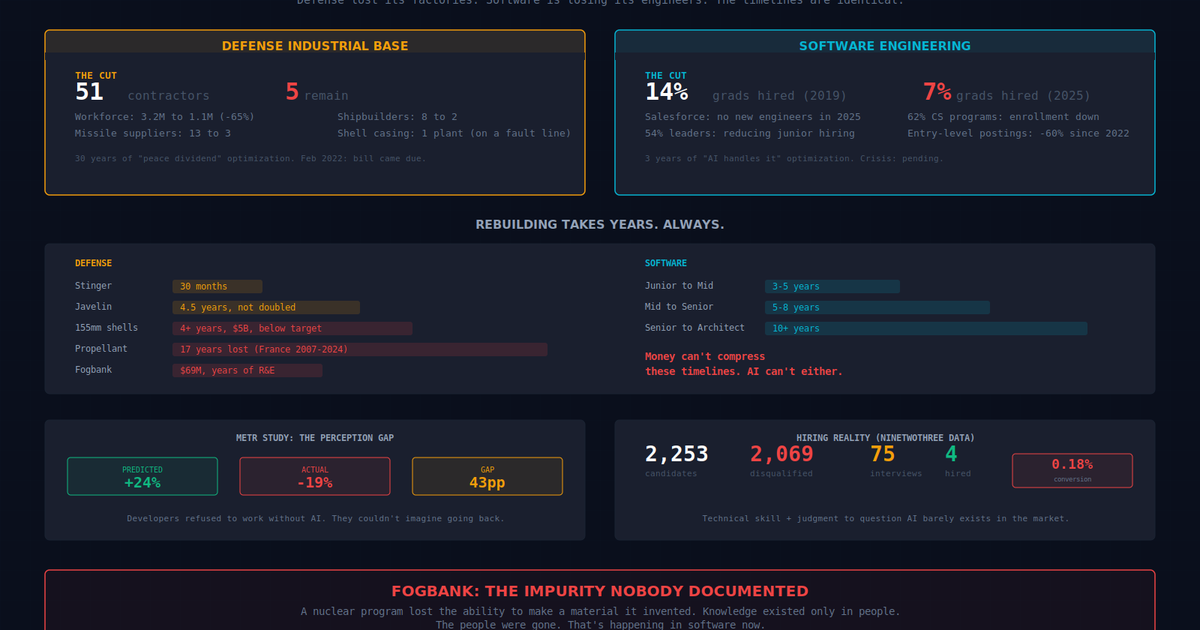

Чому Захід втрачає навички кодування: уроки оборонної промисловості для IT

Чому Захід втрачає навички кодування: уроки оборонної промисловості для IT

Український розробник створив унікальний застосунок Your Bar для змішування коктейлів вдома

Український розробник створив унікальний застосунок Your Bar для змішування коктейлів вдома

Cerebras Systems виходить на IPO: план залучити $3,5 млрд для конкуренції з Nvidia

Cerebras Systems виходить на IPO: план залучити $3,5 млрд для конкуренції з Nvidia

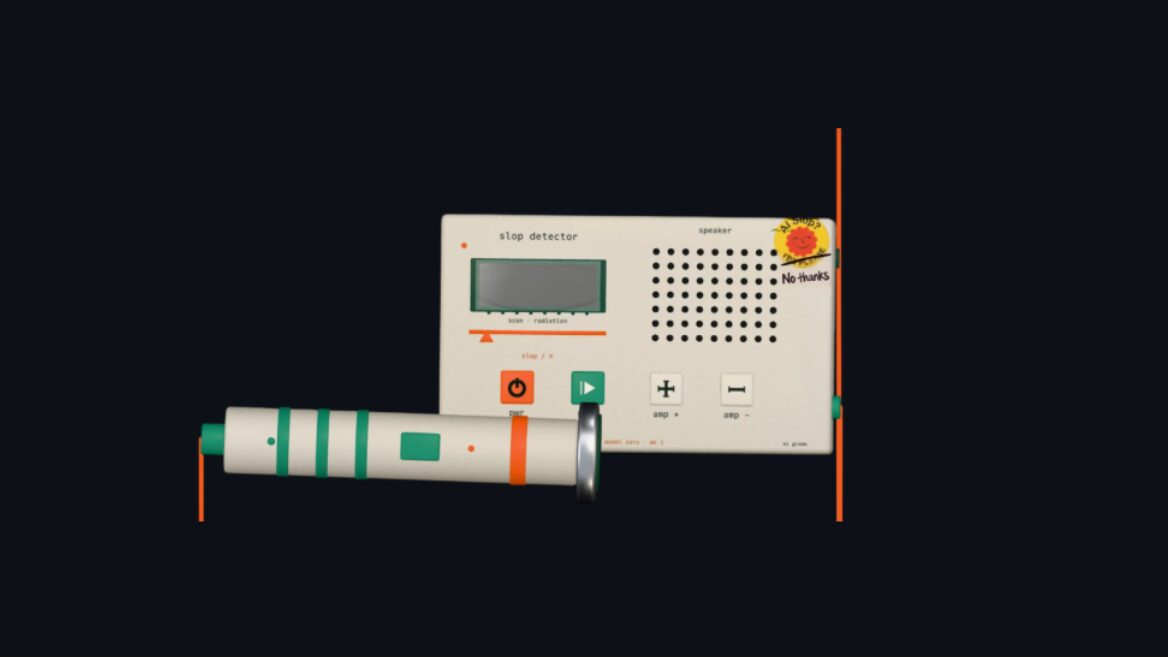

Віртуальний лічильник Гейгера для виявлення ШІ-контенту з'явився в українському інтернеті

Віртуальний лічильник Гейгера для виявлення ШІ-контенту з'явився в українському інтернеті

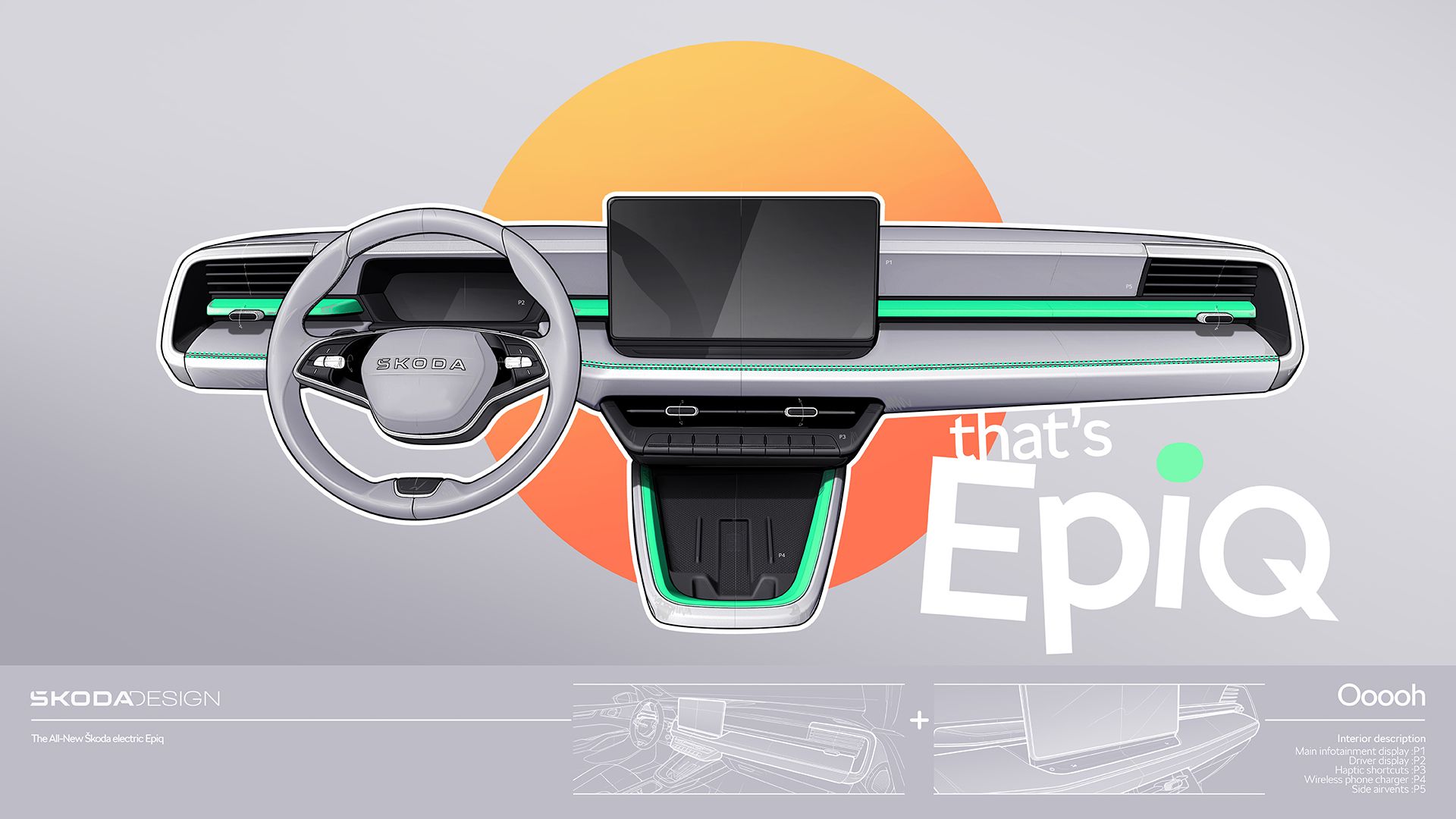

Шкода розкрила інтер'єр електрокросовера Epiq: прем'єра 19 травня 2026

Шкода розкрила інтер'єр електрокросовера Epiq: прем'єра 19 травня 2026

Новий крокуючий робот ANYmal D прискорив дослідження Марса утричі

Новий крокуючий робот ANYmal D прискорив дослідження Марса утричі

Британія отримала автономний рій дронів від української технології

Британія отримала автономний рій дронів від української технології

Чому варто відмовитися від паролів на користь ключів доступу: поради експертів

Чому варто відмовитися від паролів на користь ключів доступу: поради експертів

Особистий залік пілотів Формули-1 після Гран Прі Маямі

Особистий залік пілотів Формули-1 після Гран Прі Маямі

Сім мільйонів українців обирають портал Дія для отримання державних послуг онлайн

Сім мільйонів українців обирають портал Дія для отримання державних послуг онлайн

Коментарі

Коментарів ще немає. Будьте першим у цій дискусії.