Україна

OpenAI та Anthropic розробляють етичні стандарти для штучного інтелекту

Лідери галузі штучного інтелекту, компанії OpenAI та Anthropic, змістили фокус на створення етичних рамок для роботи своїх моделей, залучаючи до процесу філософів та експертів з моралі.

Світові лідери у сфері штучного інтелекту, OpenAI та Anthropic, розпочали спільну роботу над створенням етичних рамок для розвитку своїх технологій. Цей крок свідчить про те, що індустрія нарешті усвідомила: потужності алгоритмів недостатньо без чітких моральних орієнтирів.

Раніше розвиток ШІ сприймався виключно як інженерна задача, де вирішальними були обсяг даних та швидкість обчислень. Проте з'ясувалося, що моделі, навчені на масивах інформації, не розрізняють корисні та небезпечні патерни. Саме тому великі компанії почали залучати до своїх команд не лише програмістів, а й філософів, які допомагають визначити межі допустимого.

Anthropic пропонує концепцію «конституції» ШІ — набору принципів, за якими система оцінює власні відповіді. Це спроба вбудувати етичні норми безпосередньо в архітектуру моделі. Натомість OpenAI обирає більш гнучкий підхід, покладаючись на постійний зворотний зв'язок від користувачів для коригування поведінки штучного інтелекту.

Попри різні стратегії, всі учасники ринку стикаються з однією проблемою: відсутністю універсального етичного стандарту. Будь-яке навчання моделі моралі неминуче вимагає вибору конкретної позиції, що часто стає результатом компромісів між ідеалами та бізнес-логікою.

Цей процес змінює мову, якою ми говоримо про технології: поряд із термінами продуктивності та точності з'являються поняття довіри та відповідальності. Спроба навчити штучний інтелект етиці фактично почалася ще до того, як суспільство дійшло згоди щодо самих моральних норм.

Читайте також

- Дані — нова руда: як ШІ змінює бізнес-стратегії в українській металургії

- Штучний інтелект вперся у стелю: експерт розкрив новий вектор розвитку технологій

- Український стартап Harmix залучив $1 млн від канадських інвесторів для розвитку ШІ-платформи

- Прецедент у Китаї: суд заборонив звільняти працівників через заміну штучним інтелектом

- Вайбкодинг у Пентагоні: американські військові створюють 20 тисяч ШІ-агентів на тиждень

Новини цього розділу

Лідери цифровізації України визначили пріоритети на 2026 рік

Лідери цифровізації України визначили пріоритети на 2026 рік

Штучний інтелект вперся у стелю: експерт розкрив новий вектор розвитку технологій

Штучний інтелект вперся у стелю: експерт розкрив новий вектор розвитку технологій

SpaceX вивела на орбіту корейський супутник, запуск якого затримала війна в Україні

SpaceX вивела на орбіту корейський супутник, запуск якого затримала війна в Україні

Епоха трансформерів добігає кінця: чому ШІ-моделі вийшли на технологічне плато

Епоха трансформерів добігає кінця: чому ШІ-моделі вийшли на технологічне плато

Наземні роботи повернулися на фронт: як НРК стали незамінними в логістиці

Наземні роботи повернулися на фронт: як НРК стали незамінними в логістиці

Wix розширює команду в Україні та інвестує в безкодові застосунки

Wix розширює команду в Україні та інвестує в безкодові застосунки

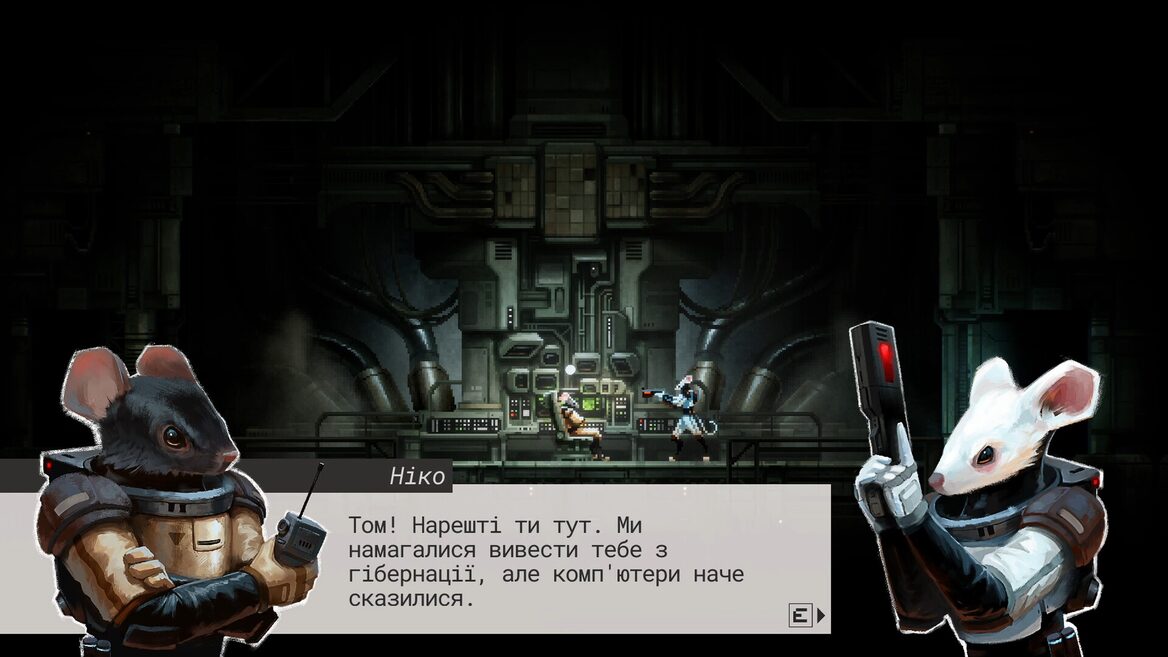

Український розробник презентував атмосферний екшен-платформер Distantia про гризунів на космічній станції

Український розробник презентував атмосферний екшен-платформер Distantia про гризунів на космічній станції

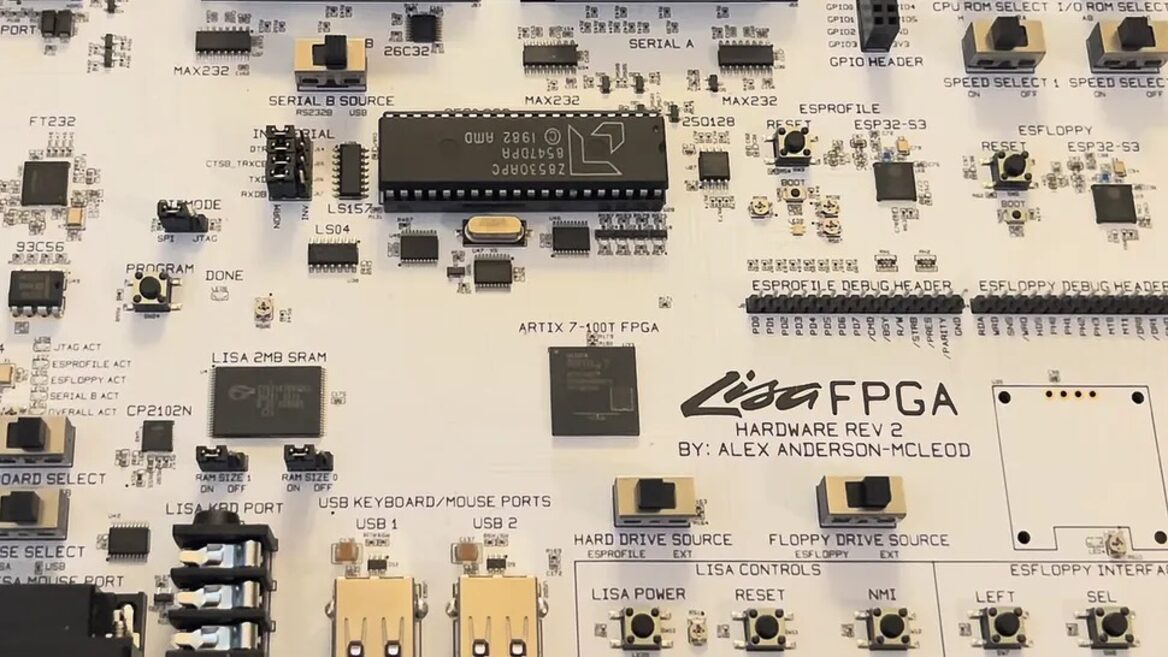

Український читач дізнався: як ютубер воскресив Apple Lisa замість $10 000

Український читач дізнався: як ютубер воскресив Apple Lisa замість $10 000

McLaren представила два гіперкари MCL-HY: один для Ле-Мана, інший — для приватних колекціонерів

McLaren представила два гіперкари MCL-HY: один для Ле-Мана, інший — для приватних колекціонерів

Робот-екскурсовод R1 представлено в історичному палаці Турину

Робот-екскурсовод R1 представлено в історичному палаці Турину

Коментарі

Коментарів ще немає. Будьте першим у цій дискусії.